点击进行在线咨询

了解更多咨询25秒搞定一张效果图?青椒云教你高效出图

以前设计师出一张效果图,可能需要几小时。但是现在利用AI工具,原来这几小时的工作,AI不用1分钟的时间可以把草稿图变成效果图!

这就是现在Stable Diffusion在建筑设计领域好用的功能点之一,帮助设计师更快速的拿到效果图方案和用户或者甲方沟通需求。

甚至,就算是普通的路人玩家,一样可以在「青椒云」上面操作Stable Diffusion轻而易举的完成草图转效果图,利用Stable Diffusion提升自己做图效率。

今天这篇文章,我们把目前比较简单且高效的“傻瓜式流程”分享给大家,看完文章,你也能马上学会用Stable Diffusion把草图变成效果图。要掌握这个技能的关键,我们还是需要使用到Stable Diffusion的controlNet插件,实现对画面的精准控制。

如果你本地的电脑没有好的显卡和安装Stable Diffusion软件或者类似的插件,推荐你直接使用「青椒云」的AIGC套餐。

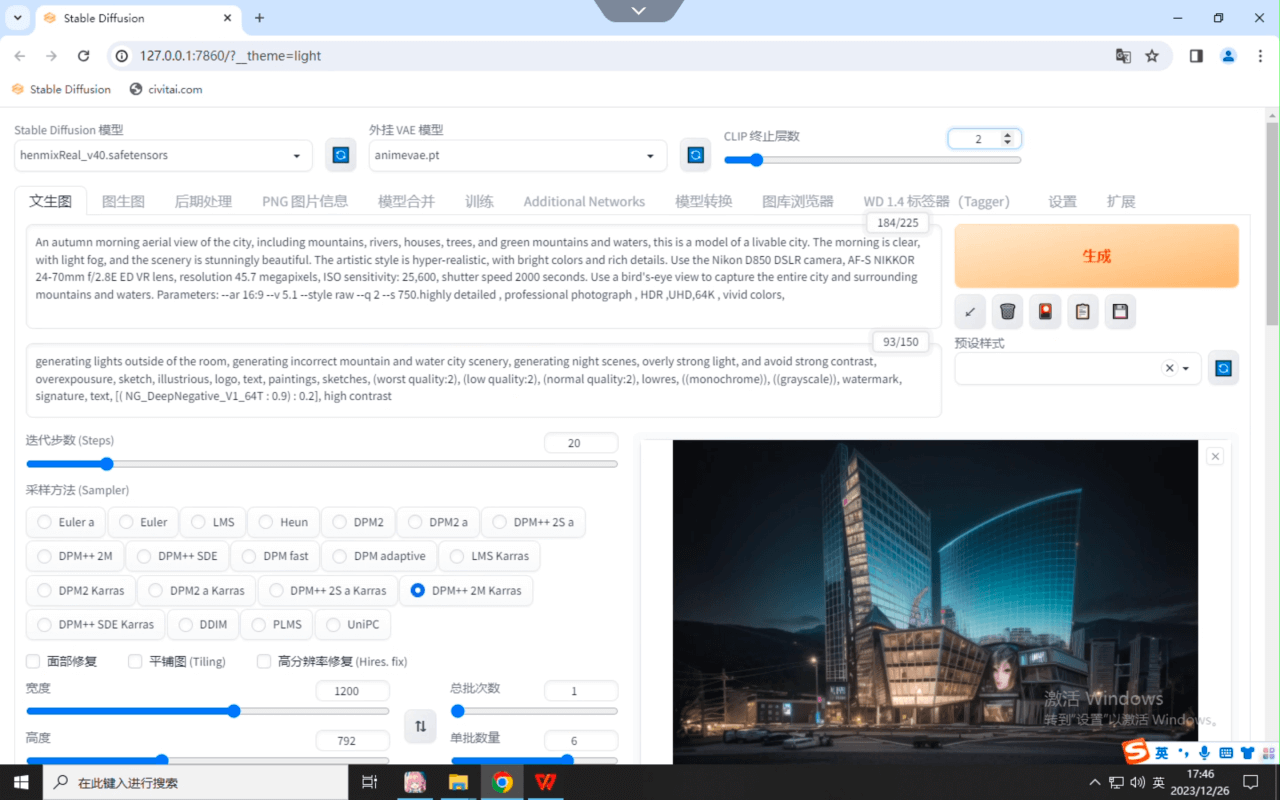

在环境准备好之后,第一步:我们需要有一个针对建筑设计行业的SD模型。推荐从c站获取景观建筑相关的模型:henmixReal_v40.safetensors。

打开c站主界面,我们直接搜索henmixReal_v40.safetensors模型,点击下载即可。

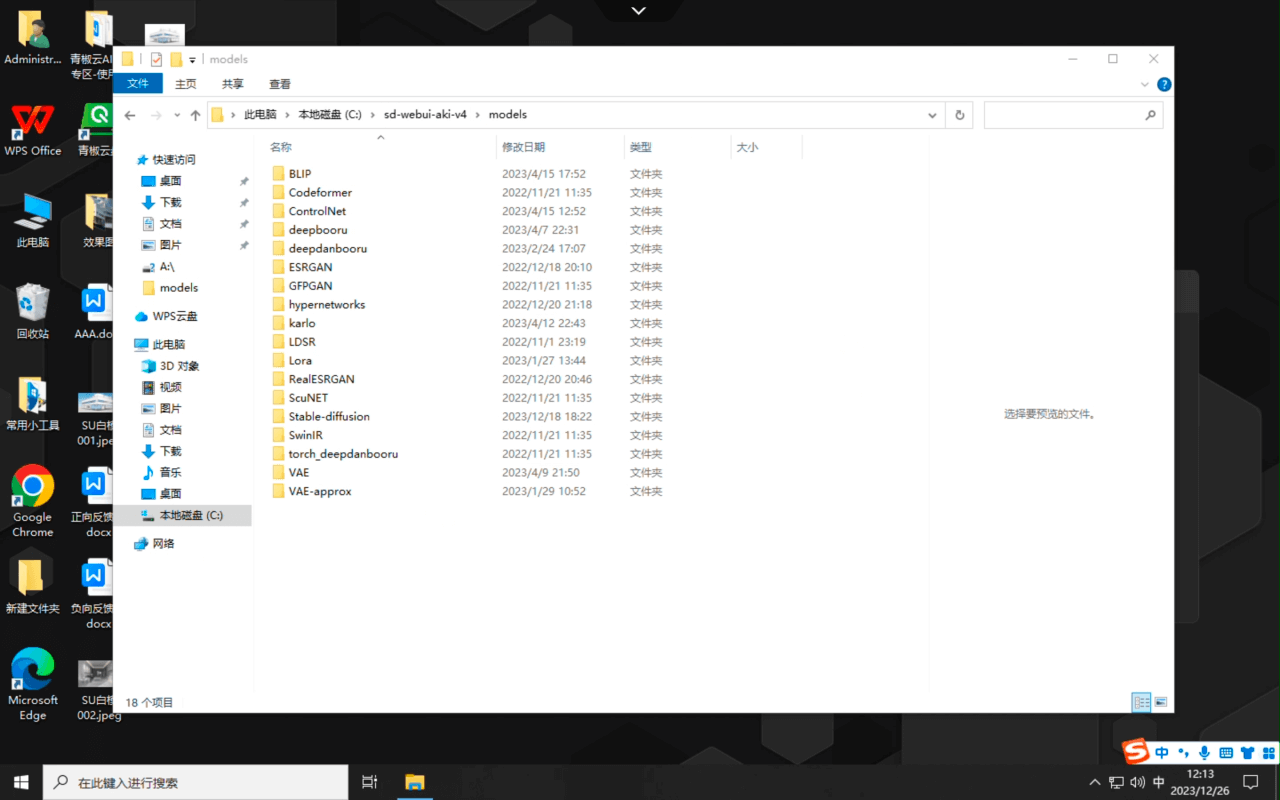

下载完成之后,我们要把这个模型剪切复制到Stable Diffusion的模型库中,模型库的路径可以看下图片。

第二步:进入「青椒云」界面,启动Stable Diffusion。

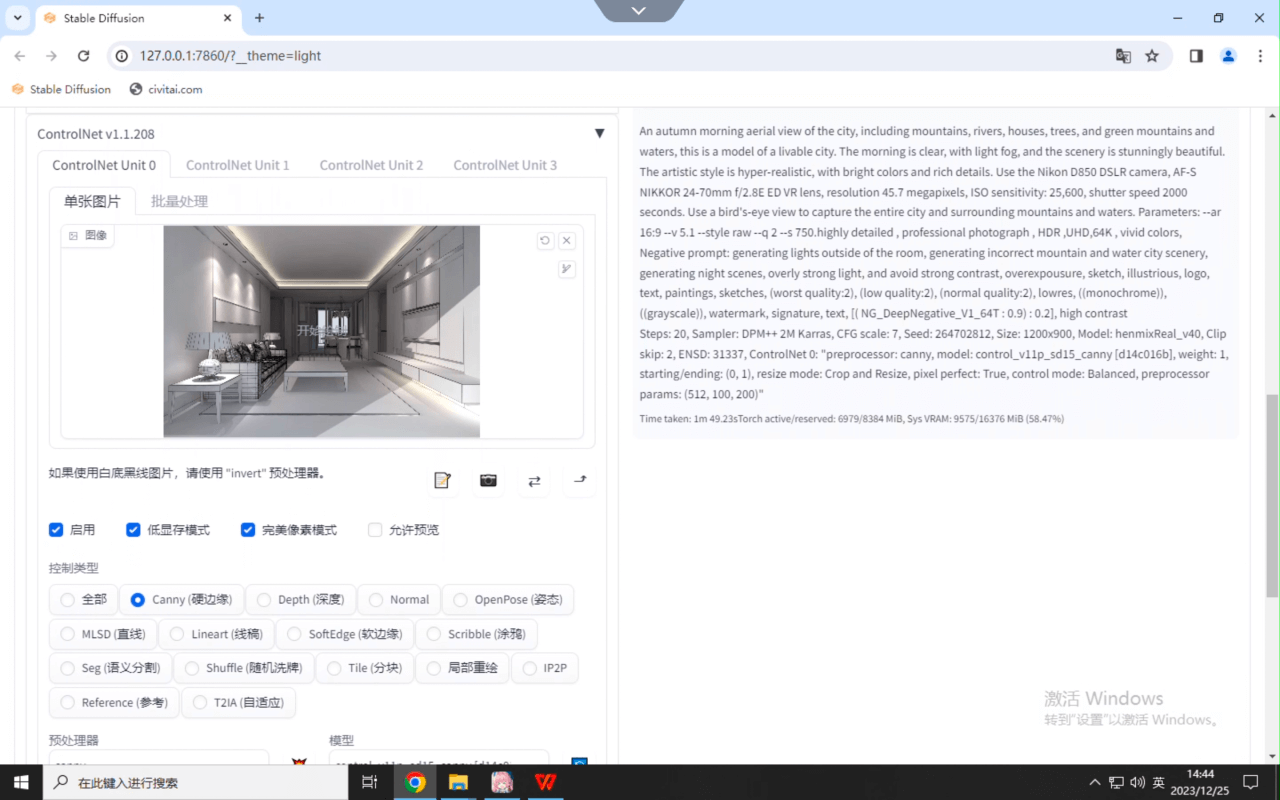

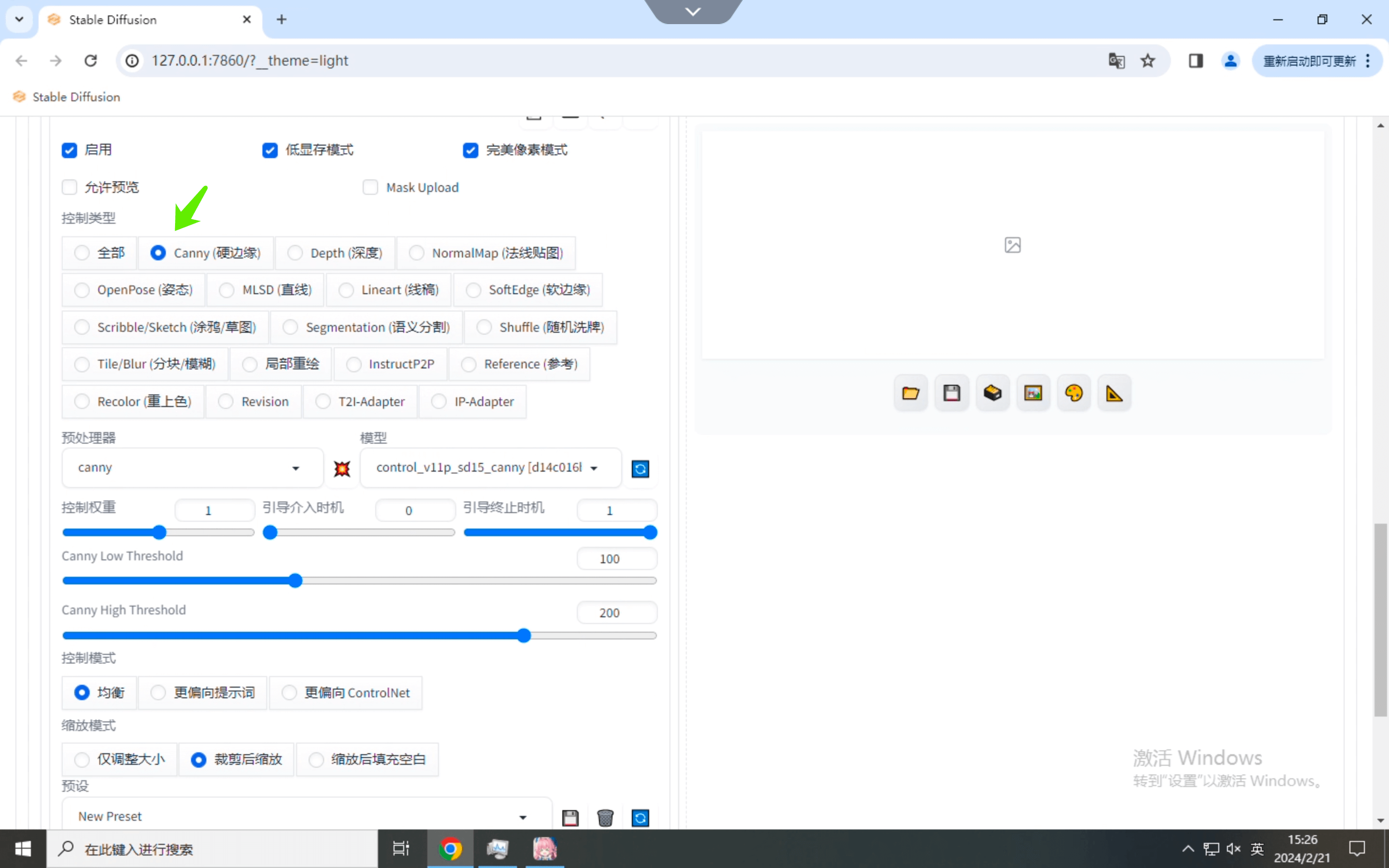

这里我们需要在Stable Diffusion中找到ControlNet插件的位置,勾选启用、高像素模式。

第三步:在ControlNet插件栏,上传我们的草稿图。

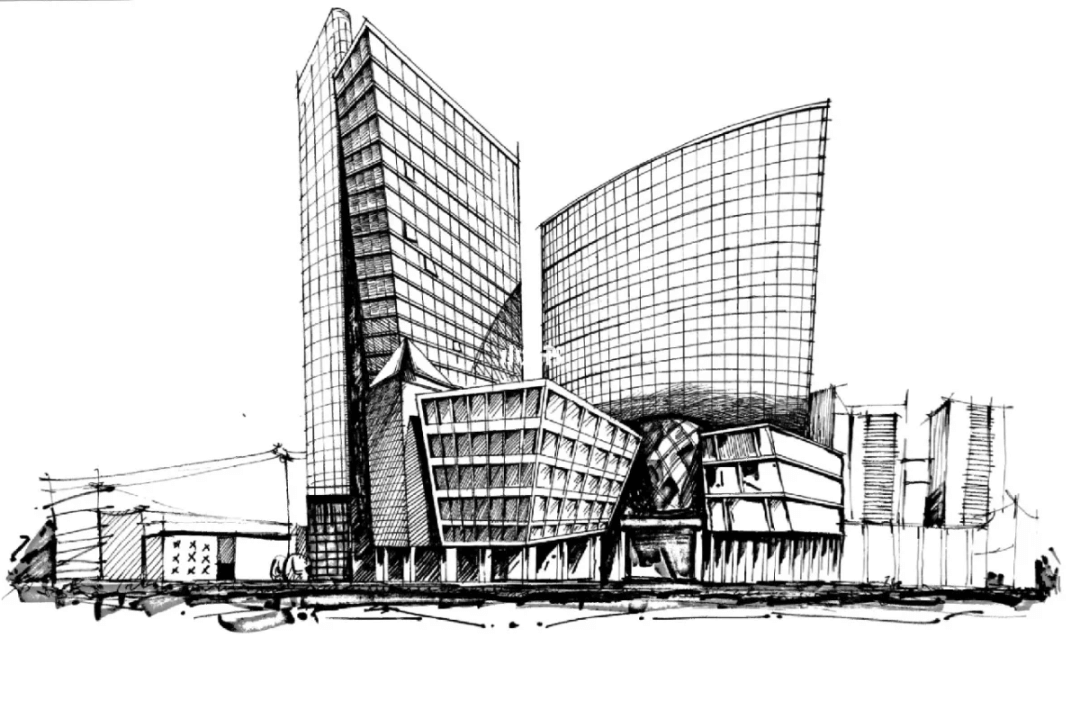

选择草稿图的时候可以随便选择一张室内或者是室外的草图都可以。或者是自己绘画的大致框架草稿图(线框及轮廓图都可以使用),需要注意的是这个草稿图底色最好是“白底黑色线条”。

第四步:上传完成图片后,我们要选择“canny硬边缘”的处理模式。

利用“canny硬边缘”来确保ControlNet可以识别到草稿图上面的主体线条。

参数配置调整之后,我们输入相要的效果提示词(可以直接使用文章中的效果词),设定尺寸。

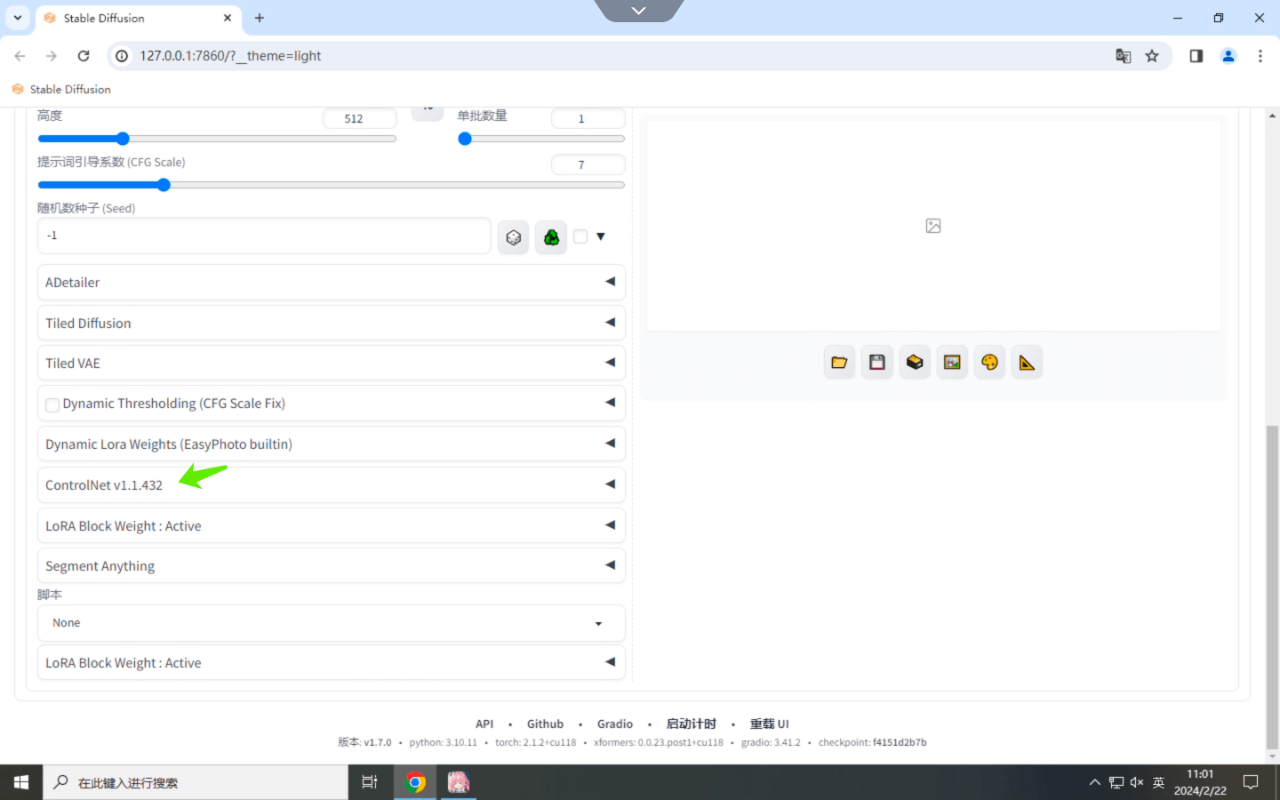

最后一步,在生成图片之前,需要在采样模式中选择:DPM++2M Karras。

这种采样方式对于基础的图片生成效果来说有更好的色彩和采样宽容性。随着采样次数的增加,人物及背景的细节都会得到相应的增强。

最后,我们也可以保持以上的参数配置,换成室内的线稿图。

然后重复上面的一些步骤,再点击生成,你就可以快速的生成一套室内的初步的效果图方案。